Leitores faciais

A inteligência artificial está se tornando melhor que os humanos em escanear rostos de animais em busca de sinais de estresse e dor. Emoções mais complexas virão?

Por Christa Lesté-Lasserre – Publicado originalmente na Science Adviser, em 13 de fevereiro de 2025 – Tradução: Google Tradutor

Às 6 da manhã de uma manhã chuvosa no interior do sudeste da Inglaterra, centenas de porcas branco-rosadas estão acordando para o café da manhã. Bufando e babando, elas trotam impacientemente em direção a dezenas de baias de alimentação, batendo umas nas outras em uma corrida louca para alcançar suas refeições matinais.

Mas primeiro, eles precisam tirar fotos.

À medida que cada porco se espreme em sua baia de alimentação, uma pequena câmera tira uma foto de seu rosto. E em menos de 1 segundo, um sistema de inteligência artificial (IA) a identifica com base apenas em seu focinho, orelhas, olhos e outras características faciais. Armada com essas informações, a IA ordena uma refeição personalizada para atirar no cocho.

Enquanto isso, o sistema continua analisando a foto dela, procurando por sinais reveladores em sua expressão facial de que ela pode estar com dor, doente ou em sofrimento emocional. Se encontrar algum, ele envia um alerta imediato ao fazendeiro — o cara que está tomando um café da manhã na sala ao lado.

Esses porquinhos famintos são os desavisados testadores beta do Intellipig , um sistema que está sendo desenvolvido por cientistas da Universidade do Oeste da Inglaterra, em Bristol (UWE) e do Rural College da Escócia (SRUC) para lidar com um problema fundamental no bem-estar animal: nós, Homo sapiens, simplesmente não somos os melhores em entender como os animais estão se sentindo.

A equipe da Intellipig não está sozinha. Cientistas ao redor do mundo estão recorrendo à IA para decifrar as expressões faciais de animais, de ovelhas a cavalos e gatos. Alguns já desenvolveram algoritmos que são mais rápidos e precisos no reconhecimento de sinais de dor e sofrimento do que os humanos mais atentos.

Essas ferramentas podem inaugurar uma nova era de cuidado com os animais que dá maior prioridade à sua saúde, bem-estar e proteção, diz Melvyn Smith, engenheiro de visão de máquina na UWE que liderou o design do sistema Intellipig. Há indícios tentadores de que eles podem ir ainda mais longe. Eventualmente, a IA pode até ofuscar os humanos na interpretação de uma gama de emoções mais complexas, semelhantes à felicidade, serenidade, frustração ou medo, diz ele — sentimentos que são igualmente importantes para entender se quisermos dar aos animais as melhores vidas possíveis.

Mas, como a maioria dos cientistas que contemplam os poderes da IA, os pesquisadores de comportamento animal se preocupam em dar muito valor às máquinas, especialmente quando o bem-estar animal está em jogo. “Talvez uma máquina acabe sendo melhor do que nós; não sei”, diz Emma Baxter, uma cientista de comportamento animal na SRUC que colabora com Smith. “Espero que haja espaço para especialistas, para garantir que [a IA] esteja realmente fazendo o que diz que está.”

OS CIENTISTAS SABEM HÁ MUITO TEMPO que, assim como nós, os animais transmitem como estão se sentindo por meio de seus rostos. Em The Expression of the Emotions in Man and Animals , publicado em 1872, Charles Darwin sugeriu que as expressões faciais eram uma espécie de “linguagem compartilhada” entre os mamíferos, uma habilidade que deve ter evoluído profundamente em nossa história evolutiva.

Ele baseou essa teoria amplamente na anatomia, diz Bridget Waller, psicóloga da Nottingham Trent University. Mamíferos — incluindo humanos — têm muitos músculos faciais comuns cujo propósito é criar expressões faciais. Compartilhamos 38 % dos nossos movimentos faciais com cães, por exemplo, 34% com gatos e 47% com primatas e cavalos.

Ainda assim, as similaridades anatômicas não significam que podemos ler os rostos dos animais como os de outros humanos. Então, pesquisadores que estudam a comunicação animal frequentemente inferem o que um animal está vivenciando por meio do contexto.

Dor é o exemplo mais óbvio: um cavalo que acabou de ser castrado ou uma ovelha mancando com podridão fedorenta e avermelhada nas patas está, sem dúvida, sentindo dor. Pesquisadores que estudam expressões animais também podem induzir um leve desconforto — apertando um manguito de pressão arterial em volta de uma perna, por exemplo, ou passando um pouco de extrato de pimenta na pele. Dar analgésicos a um animal, por outro lado, geralmente parece fazê-lo se sentir melhor.

Da mesma forma, é fácil induzir estresse menor em muitas espécies, como cavalos e gatos, levando-os para um passeio curto ou separando-os de seus amigos por alguns minutos. Para estudar o estresse em porcas jovens, Baxter simplesmente traz as mais velhas, que as intimidam agindo de forma dominante. Comportamento ansioso, como gritar e defecar, e níveis exorbitantes do hormônio do estresse cortisol podem confirmar que um animal está estressado.

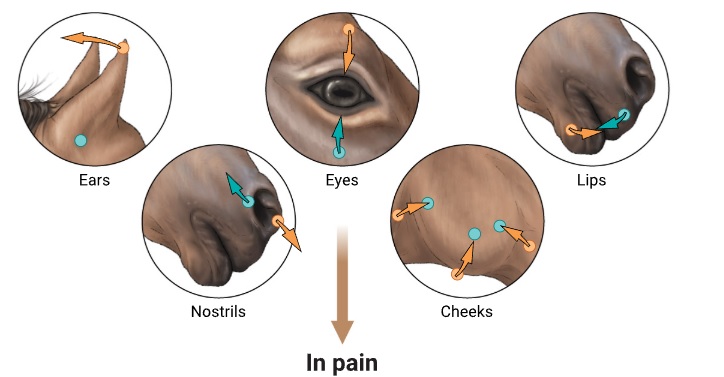

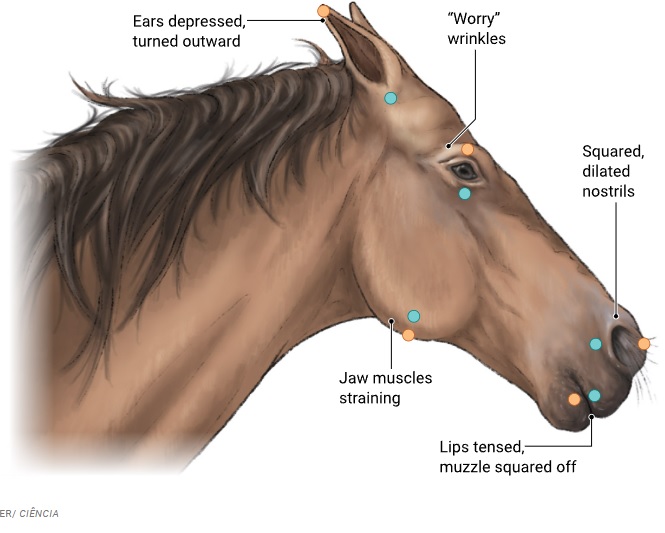

Cientistas passaram milhares de horas sentados em frente a baias e gaiolas observando os rostos de animais nessas situações dolorosas ou estressantes, depois comparando-os com animais que provavelmente estavam livres de dor ou estresse. Como resultado, eles desenvolveram “escalas de careta” para uma variedade de espécies, que fornecem uma medida de quanta dor ou estresse um animal está experimentando com base nos movimentos de seus músculos faciais.

Por exemplo, um cavalo que gira as orelhas para fora enquanto forma “rugas de preocupação” acima dos olhos tem mais probabilidade de sentir dor do que um que mantém as orelhas e os olhos relaxados, diz Pia Haubro Andersen, uma cirurgiã de cavalos na Universidade Sueca de Ciências Agrícolas ( veja o gráfico abaixo ). Os cavalos sinalizam estresse com movimentos de orelhas e rugas semelhantes, mas com diferenças sutis, como mostrar a língua, ela acrescenta.

Especialistas na área se tornaram hábeis em codificar manualmente tais movimentos faciais em animais, o que poderia — em teoria — permitir verificações de bem-estar. Mas é um trabalho incrivelmente tedioso, diz Andersen. Codificadores humanos precisam de uma média de 100 segundos para identificar os vários músculos faciais e codificar suas posições em uma única imagem, ou de 2 a 3 horas para 30 segundos de vídeo.

A IA, por outro lado, pode realizar a mesma tarefa quase instantaneamente, mas primeiro precisa ser ensinada.

DE SEU ESCRITÓRIO na Universidade de Haifa, a cientista da computação Anna Zamansky passou muitos dias úteis abafando o barulho das sirenes e explosões da guerra entre Israel e o Hamas. Em várias ocasiões, ela levou seu laptop e sua querida poodle chocolate Becky — que também serve como sua modelo de pesquisa favorita — para um abrigo antiaéreo.

Ao contrário dos cientistas nos escombros das universidades de Gaza, no entanto, a equipe de Zamansky conseguiu prosseguir com sua pesquisa. Eles estão treinando sistemas de IA para ler automaticamente os rostos dos animais — na esperança de tornar suas vidas melhores. “Colocar nossos cérebros e nossas melhores habilidades para fazer algo tão bom quanto o bem-estar animal? Isso realmente nos ajuda a sobreviver durante esses tempos difíceis”, diz ela. “Isso nos faz sentir esperançosos.”

Zamansky começou desenvolvendo um software de reconhecimento facial para ajudar as pessoas a encontrar seus cães perdidos. Os donos carregam uma foto do rosto de seus cães no software, que procura uma correspondência em um banco de dados de imagens de vira-latas enviadas por estranhos preocupados. Zamansky e seu co-desenvolvedor George Martvel, um aluno de doutorado que escapou do recrutamento russo na guerra contra a Ucrânia, doaram a tecnologia para organizações de assistência que trabalham na Ucrânia e em zonas de inundação no Brasil, onde ajudou a reunir dezenas de cães perdidos com seus donos.

Mais recentemente, a equipe se voltou para uma tarefa mais difícil: usar IA para identificar os sinais frequentemente sutis de desconforto nos rostos dos animais. Primeiro, o sistema de IA deve aprender a identificar as partes do rosto cruciais para criar expressões. Isso envolve sinalizar manualmente “marcos” importantes associados aos movimentos musculares — a parte superior e inferior de um olho, digamos, ou as laterais de uma narina — em inúmeras fotos de animais e converter as imagens em uma massa de pontos digitais, como uma página em um livro de ligar os pontos de uma criança. Com a ajuda de freelancers no Quênia, Martvel e seus colegas marcaram “milhares e milhares” de rostos de uma variedade de espécies, incluindo gatos, cães, cavalos e primatas.

Os cientistas podem então alimentar uma infinidade de fotos de pontos de referência em sua IA, para ensiná-la a encontrar pontos de referência em novas imagens por conta própria. Em um trabalho pioneiro em 2016 , por exemplo, Peter Robinson, um cientista da computação da Universidade de Cambridge, e sua equipe se basearam em pesquisas que analisavam rostos humanos para desenvolver uma ferramenta que encontra automaticamente a boca, os olhos e as pontas das orelhas em rostos de ovelhas. Um ano depois, cientistas da computação da Universidade da Califórnia, Davis criaram um programa treinado em imagens de rostos humanos que coloca automaticamente pontos de referência em rostos de cavalos e ovelhas, uma vez que eles foram distorcidos em um formato mais humano .

A IA da Martvel agora é tão boa em marcação automática que consegue até descobrir onde colocar pontos em rostos que não consegue ver completamente — como quando um cachorro enterra o focinho em uma tigela de comida ou um gato espia por trás do sofá, diz ele.

Uma vez que o marco esteja completo, a IA pode identificar expressões faciais específicas analisando as distâncias entre esses marcos. Por exemplo, se um gato alarga e tensiona seu focinho — um sinal de que ele pode estar com dor — a distância entre dois pontos nas bordas da boca se alarga. Ao cruzar essas expressões com as escalas de caretas que os pesquisadores já criaram, a IA pode procurar por sinais reveladores de dor ou sofrimento.

Expressões de dor

Cientistas avaliam o nível de dor de um animal procurando por movimentos musculares reveladores ao redor dos olhos, orelhas e outras características faciais. Sistemas de inteligência artificial (IA) fazem julgamentos semelhantes medindo a distância entre “pontos de referência” no rosto (pontos laranja e azul-petróleo).

Mudanças sutis

Os sistemas de IA estão se tornando mais rápidos e precisos do que os humanos em determinar se um animal está com dor. Isso ocorre em parte porque eles podem identificar os menores movimentos musculares e encontrar novos indicadores de dor dos quais os humanos nem sequer têm consciência.

O resultado de todo esse treinamento meticuloso são sistemas de IA que podem diagnosticar problemas de bem-estar com precisão impressionante. A IA de Robinson, por exemplo, selecionou com sucesso o punhado de ovelhas dentro de um rebanho que estavam sofrendo de podridão dos cascos ou mastite. E em 2023, Zamansky e seu aluno Marcelo Feighelstein descobriram que sua IA tinha 77% de precisão em determinar se um gato estava com dor .

EMBORA EFICAZES, ESTAS FERRAMENTAS ainda dependem dos humanos para fazer a chamada inicial sobre o que procurar na expressão de um animal. Então, recentemente, os pesquisadores têm passado ainda mais rédeas para a IA. Em vez de ensinar sistemas de computador a procurar expressões predeterminadas de dor ou estresse, alguns cientistas estão simplesmente dando à sua IA imagens de animais em diferentes situações e deixando-os identificar sinais reveladores por conta própria, por meio de um processo chamado aprendizado profundo.

Essa é a abordagem usada por Gabriel Lencioni, veterinário e aluno de doutorado em comportamento e bem-estar de cavalos na Universidade de São Paulo. Em um trabalho recente, ele deu ao seu sistema de IA fotos de rostos de cavalos antes e depois da cirurgia, e depois antes e depois de seus analgésicos regularmente planejados, instruindo a máquina a se concentrar especificamente nas diferenças nos ouvidos, olhos e boca. Após o treinamento em 3000 imagens, “a IA aprendeu sozinha”, ele diz; no final, ela foi capaz de diagnosticar corretamente se um animal estava com dor 88% das vezes . Andersen e sua colega Sofia Broomé, uma pesquisadora de visão computacional agora na Sleip AI, desenvolveram uma ferramenta semelhante treinada em vídeos de cavalos, em vez de imagens; em testes, a IA não apenas reconheceu sinais de dor que os veterinários não tinham percebido, mas também declarou corretamente que os animais estavam sem dor quando os especialistas acreditavam que eles estavam com dor. .

O sistema Intellipig que está sendo testado em fazendas inteligentes do Reino Unido também usa aprendizado profundo. A IA não só supera os humanos no reconhecimento de porcos individuais, com uma taxa de precisão de 97% , mas também provou ser notavelmente habilidosa em detectar estresse apenas por meio de características faciais, diz Smith.

E no início deste ano, o grupo de Zamansky publicou resultados mostrando que uma IA de rédea livre era consistentemente melhor em detectar dor em ovelhas do que até mesmo veterinários e especialistas em comportamento altamente qualificados . O algoritmo determinou corretamente que uma ovelha havia saído de uma cirurgia dolorosa em 82% dos testes; quatro humanos altamente treinados mostrados nos rostos das ovelhas acertaram apenas 70% das vezes.

Zamansky compara essas vitórias de IA ao triunfo histórico de 1997 do Deep Blue, o supercomputador da IBM que derrotou o mestre de xadrez russo Garry Kasparov na frente de milhões de fãs. “Como todo mundo reagindo à IA hoje em dia, a primeira reação de Kasparov foi pânico. Todo mundo pensa, ‘Meu Deus, a IA vai tirar meu emprego!’”, diz Zamansky. “Mas então eles entendem que a IA é apenas uma ferramenta realmente poderosa que pode aprimorar suas próprias habilidades.”

Ainda assim, Zamansky adverte que um computador que é livre para decidir o que procurar em imagens pode capturar as características erradas. Um exemplo clássico é um relógio no fundo. Imagine, por exemplo, que pesquisadores tirassem fotos de animais felizes ou sem dor todos os dias às 10 da manhã, como parte de um protocolo científico padrão, e então outras fotos desses animais na condição oposta às 5 da tarde. “Se a máquina vir uma imagem de um relógio às 10 da manhã, ela dirá que é um coelho sem dor”, ela diz — mesmo que não seja.

Não ter nenhuma percepção de como a IA está realmente tomando decisões perturba os pesquisadores. “Todos estão preocupados com a caixa preta, porque não sabem o que a máquina decide, ou por quê”, diz Zamansky, cuja aluna Tali Shitrit dedicou sua dissertação a descobrir o que, exatamente, a IA do grupo procura em rostos de animais. Ela usa uma ferramenta chamada Mapeamento de Ativação de Classe com Peso Gradual, ou GradCAM, que produz mapas de calor mostrando em quais áreas do rosto a IA se concentra ao tomar suas decisões.

Até agora, ela descobriu que a máquina geralmente considera a área dos olhos a mais informativa, entre conjuntos de dados e espécies. Em gatos, no entanto, os mapas são mais quentes ao redor do nariz e da boca , de acordo com o trabalho feito com o veterinário Holger Volk na Universidade de Medicina Veterinária de Hannover.

Apesar dos problemas, alguns pesquisadores estão indo além, buscando sistemas que consigam ler emoções mais complexas do que estresse e dor — aquelas mais parecidas com as experiências humanas de alegria, raiva ou tristeza.

BRITTANY FLORKIEWICZ , psicóloga evolucionista do Lyon College, viu mais do que sua cota justa de vídeos de gatos. Ela e sua equipe passaram centenas de horas assistindo a gravações de gatos brincando e brigando em um café para gatos em Los Angeles, codificando meticulosamente cada detalhe das expressões faciais dos animais enquanto procuravam por sinais em seu comportamento de que eles estão, essencialmente, “felizes” — ou não.

O trabalho revelou que os gatos fazem incríveis 276 expressões faciais distintas . Agora, Florkiewicz se uniu a Martvel e Zamansky para aplicar IA aos seus dados. A tecnologia já mostrou que esses gatos de café tendem a imitar sutilmente as expressões faciais uns dos outros — geralmente em um convite para criar vínculos por meio de cuidados pessoais ou brincadeiras.

Em um trabalho semelhante, a equipe de Zamansky treinou sua IA em fotos de labradores que estavam ansiosamente esperando por uma guloseima ou conseguiam ver a guloseima, mas frustradamente eram impedidos de alcançá-la. A IA conseguiu detectar com sucesso se um cão estava “feliz” ou “frustrado” 89% das vezes. Foi igualmente bem-sucedida em diferenciar cavalos “felizes” de “frustrados”. No mesmo experimento, alguns cavalos foram filmados quando descobriram que uma guloseima esperada não estava lá, afinal. Os pesquisadores descobriram que sua IA conseguiu categorizar corretamente um cavalo como “frustrado” ou “decepcionado” em 61% dos testes — uma taxa de sucesso modesta, mas melhor do que o acaso.

Para desenvolver esses sucessos, Martvel e Zamansky agora estão construindo bancos de dados de rostos de cães, gatos, cavalos e primatas em diferentes estados emocionais. A equipe vasculha a internet em busca de fotos em que os donos forneceram uma descrição clara do contexto — e, portanto, das prováveis emoções dos animais. Ao executar as fotos por meio de IA, eles esperam decifrar as distintas expressões faciais que uma espécie apresenta em cada cenário emocional único.

O “sonho” de Zamansky, ela diz, é ter um “leitor de rosto de cachorro” que revele estados emocionais básicos como felicidade, tristeza e estresse — um desafio particular para a IA dada a grande variedade de formatos faciais e de orelhas entre raças de cães. “Não é possível agora, eu sei”, ela diz. “Mas em um ano, será possível. É isso que continuamos dizendo a nós mesmos — e estamos trabalhando duro nisso.” Um dia, Florkiewicz diz, as máquinas podem até começar a conectar certas expressões faciais com “intencionalidade” — discernir quando um animal tem um objetivo, como sair, pegar um brinquedo ou começar uma briga.

Um desafio é acumular os dados de treinamento. “Eles treinaram o ChatGPT com um volume de literatura que é aproximadamente equivalente a metade de toda a biblioteca da universidade em Cambridge — que tem uma cópia de cada livro já publicado no Reino Unido”, diz Robinson. “Mas acontece que não há muitas fotos de cães, gatos e ovelhas na internet” — pelo menos não aquelas em que fica claro como os animais estão se sentindo, ele diz.

E as expressões faciais não contam toda a história , diz Elodie Briefer, especialista em comunicação animal da Universidade de Copenhague, que vem desenvolvendo IA para interpretar emoções em chamados de porcos e zebras. Para sondar as emoções dos animais, a IA deve olhar além do rosto para fatores como abanar o rabo ou uma postura curvada, diz Suresh Neethirajan, engenheiro agrícola da Universidade Dalhousie. Seu próprio sistema de verificação de bem-estar de IA para animais de fazenda analisa até mesmo as emissões de calor corporal — uma pista importante para galinhas e outras espécies que têm expressões faciais limitadas.

APESAR DESSAS LIMITAÇÕES , a IA facial já oferece oportunidades “pragmáticas e realistas”, diz Zamansky. Sua equipe está prestes a lançar um aplicativo baseado em IA que permitirá que donos de gatos escaneiem os rostos de seus animais de estimação por 30 segundos e imediatamente obtenham mensagens fáceis de ler, como “Considerável tensão ao redor da boca detectada; nível de dor moderado”.

Pesquisadores na Holanda desenvolveram um aplicativo semelhante que escaneia rostos e corpos de cavalos em repouso para estimar seus níveis de dor. A IA poderia eventualmente ser usada durante competições equestres, sugere Lencioni, para recompensar cavaleiros de cavalos felizes e confortáveis e melhorar o bem-estar e a justiça no esporte.

De forma mais geral, laboratórios e abrigos para animais de estimação poderiam aproveitar a IA para monitorar a dor e os estados emocionais em animais, diz Floriekwicz. E “ fazendas inteligentes ” — como aquelas que estão sendo testadas no interior da Inglaterra — prometem fornecer cuidados individualizados aos animais por meio de monitoramento diário. No final das contas, diz Smith, os ajudantes de IA poderiam orientar os fazendeiros a dar aos porcos não apenas uma vida sem estresse, mas uma vida feliz.

Para Zamansky, essa perspectiva faz todo o seu trabalho valer a pena. “Meu trabalho é ser uma agente para vidas melhores para os animais”, ela diz. “Quando sabemos que nossos companheiros animais estão felizes, isso nos deixa felizes também.”